无人驾驶感知模块技术理念解析

发布日期: 2020-12-02来源: 汽车电子与软件

在无人驾驶的多个技术栈中,感知模块负责解析和理解周围环境,在帮助无人车安全穿行于复杂城市公开道路场景、实现L4无人驾驶上起着重要的作用。在路上,无人驾驶车辆不仅要感知到远处高速行驶的机动车,也要感知到近处的不明障碍物(Debris),借助失效模式彼此正交的多种传感器,结合数据与规则驱动算法,高并行的融合/处理传感器数据,为安全、高效、成本可控的无人驾驶方案保驾护航。

但目前,自动驾驶的感知系统仍存在一些根本问题值得进一步探索,例如长尾问题无法即时处理、多步多模块系统还是端到端的人工智能算法、激光雷达为主还是“camera only”,传感器前融合还是后融合等等。本文将分享对于感知模块的几点理解和思考,与各位读者探讨。

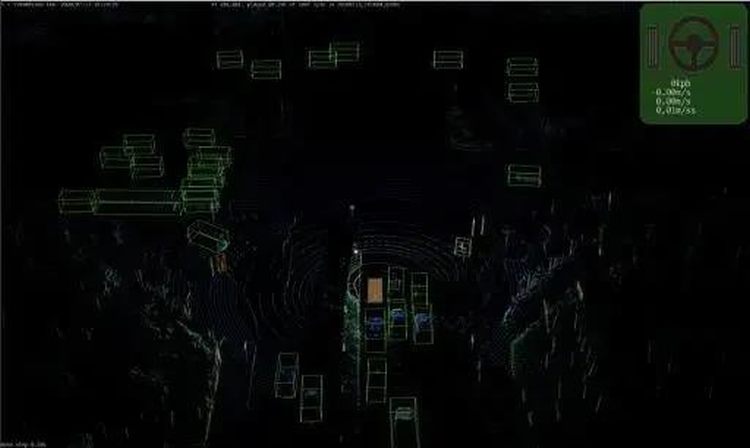

无人驾驶特点之一是安全关键(safety critical),一个产品级的无人驾驶方案需要能够准确掌握自车周边全视角不同尺度大小的物体信息。感知系统借助覆盖无死角的传感器布局,可以拿到周围的环境信息。其中最主要的传感器——激光雷达、相机和毫米波雷达以大于等于10Hz的频率将激光雷达点云、高分辨率图像以及雷达跟踪对象等信息源源不断地发布给感知模块。业内有许多种不同的方式来实时处理这些信息,不同的处理方式,往往体现了不同的团队对于感知模块,甚至无人驾驶系统的理解。传统的方式将对于感知输入信息的处理定义为信息检索问题(Information Retrieval Problem),即把这些输入的数据当作信息源,通过感知模块将兴趣区域(Region Of Interest)检索出,对其进行处理并发布给下游模块。时下非常流行的目标物检测(Object Detection),就是信息检索这种方法论的一种应用。其是指在一个激光雷达点或者图像像素集合中,找到若干个子集,用2D或者3D定向/非定向方框(oriented/axis-aligned bounding box)的形式表示其范围。

通过检索,系统可以很快的找到数据中的感兴趣区域,并顺带拿到一些属性。其中就包括作为动态交通参与者(Road Agents)的车/人/骑行者和作为交通控制单元(Traffic Controllers)的锥桶/红绿灯/交通标志等等。由于其自身的重要性,以及在实际道路数据中的丰富性,这些物体成为需要检索的目标信息。这些信息足够帮助无人车驾驭现实场景中80%的情况。

但作为一款产品,无人驾驶汽车还需要有效处理另外20%的边界化难题(corner cases),也就是业内所提到的长尾问题(long-ail problem)。由于其自身的多样性和稀疏性,长尾问题很难用兴趣区域的方式稳定地进行信息检索。例如以下这些情景中,无人车在路上可能会遇到动物、掉在地上的杂物、飘落的落叶等等。现实中,总会有一些情况是没有预料到的、或者已经预见到但却没有足够的数据的来解决的。这导致感知系统存在较大的安全风险。

轻舟智航的感知团队更倾向于将无人驾驶感知方案中的对于感知输入信息的处理理解为一个统计分类问题(Statistical Classification Problem),即解释分类当前系统中拿到的每一个数据点。这些数据点包括了线上传感器发布的激光雷达点、图像像素点、雷达数据点,以及通过V2X接收的路端/车联网信息等,也包括了“线下传感器”发布的高精地图底图(imagery)、语义地图(semantic map)、环境语义历史(semantic history)等先验信息。在得到当前帧的传感器数据后,感知模块将对于得到的每一个数据点进行理解分类,进而进行交叉验证(cross validation)。

对于长尾问题,轻舟智航的感知系统假设至少有一个或多个模态(modality)可以提供一些信息,也就是如果在任意几个模态经过交叉验证后依然在某些区域出现较高的不确定性,那就发布信息促使无人车行为发生改变,比如避让或是谨慎驾驶。

不放过对任何数据点的解释,可以尽可能的发掘利用已知信息,避免遗漏,提升感知能力,降低安全风险。轻舟智航团队通过对于感知模块更高层次理解的定义,加深了自身对于安全关键的认识,从而更好的打造适应城市复杂公开道路场景的L4无人驾驶方案。